Abstract

在本文中,我们对人体姿势估计问题感兴趣,重点是学习可靠的高分辨率表示。大多数现有方法分辨率从高到低再从低到高恢复。相反,我们提出的网络在整个过程中都保持高分辨率表示。

我们将高分辨率子网作为网络第一部分,然后将由高到低分辨率的子网逐步添加到网络中,然后将多分辨率子网并行连接。我们进行反复的多尺度融合,以便每一个高到低分辨率的表示都反复从其他并行表示中接收信息,从而获得丰富的高分辨率表示。因此最终预测的关键点热图可能更准确,空间上更精确。我们通过在两个基准数据集(COCO关键点检测数据集和MPII Human Pose数据集)上得到更好的姿态估计结果,证明了我们网络的有效性。此外,我们在PoseTrack数据集上显示了我们的网络在姿势跟踪中的优越性。代码开源

1 Introduction

二维人体姿势估计已成为计算机视觉中的一个基本但仍具有挑战性的问题。目标是定位人体解剖学要点(例如肘部,腕部等)或部位。它具有许多应用,包括人类动作识别,人机交互,动画[6, 26, 32, 38, 46, 55, 40, 45, 17, 69]等。本文对单人姿势估计感兴趣,它是其他相关问题的基础,例如多人姿势估计,视频姿势估计和追踪[48, 70]等。

最近的研究表明,深度卷积神经网络已经实现了最先进的性能。现有的大多数方法都通过网络(通常由串联的高到低分辨率子网组成)传递输入,然后再提高分辨率。例如,沙漏[39]通过对称的从低到高的过程来恢复高分辨率。SimpleBaseline[70]采用一些转置的卷积层来生成高分辨率表示。此外,空洞卷积还用于扩张高至低分辨率网络(例如VGGNet或ResNet)后面的层[26,74]。

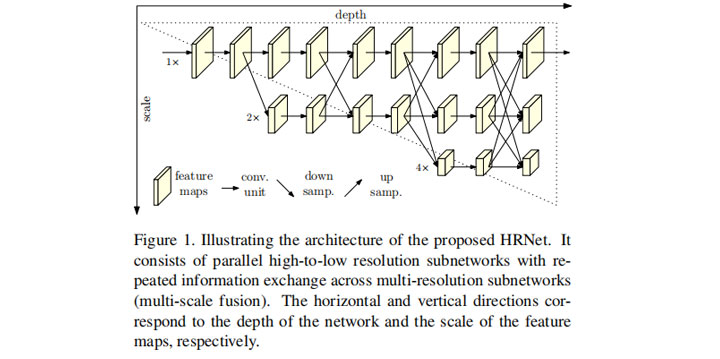

我们提出了一种新颖的架构,即高分辨率网络(HRNet),它能够在整个过程中保持高分辨率表示。我们从高分辨率子网开始作为第一阶段,将高到低分辨率子网逐个添加以形成更多阶段,并并行连接多分辨率子网。我们通过在整个过程中一遍又一遍地在并行多分辨率子网中交换信息来进行重复的多尺度融合。我们估算网络输出的高分辨率图像的关键点。网络最终结构如图1所示。

我们的网络相比目前广泛使用的网络有两大优势。(1)我们的模型并行连接由高到低分辨率的子网络而不是目前方法的序列模式。因此我们的模型能一直保持高分辨率而不用从由低到高的过程中恢复高分辨率,因此预测的热力图可能在空间上更精准。(2)大多数现有方案融合网络的底层和高层表达。相反,我们在同深度和相似级别下低分辨率表示的帮助下,进行重复的多尺度融合来提高高分辨率表示,使得高分辨率表示也富有动作信息。因此我们预测的热力图会更准确。

我们在两个基准数据集上经验性证明了我们方法有更好的关键点检测表现: the COCO keypoint detection dataset 和 the MPII Human Pose dataset。此外,我们展示了我们的模型在PoseTrack数据集上视频姿态跟踪方面的优越性。

2 Related Work

3 Approach

人体姿态估计,又称关键点检测,是指从大小为W×H×3的图像I中检测出K个关键点或身体部位(如肘部、腕部等)的位置。当前SOTA方法把问题转变成了估计K个W’xH’的热力图,每个图Hk表示第k个关键点的位置置信度。

我们遵循广泛采用的方式使用卷积网络预测人体关键点,然后接两个降低分辨率的跨步卷积组成的分支,一个输出与其输入特征图具有相同分辨率的特征图,一个估计热图的回归器,在该热图中选择并转换了关键点位置 达到完整的分辨率。 我们专注于主体的设计,并介绍我们的高分辨率网络(HRNet)。

Sequential multi-resolution subnetworks 串行多分辨率子网络

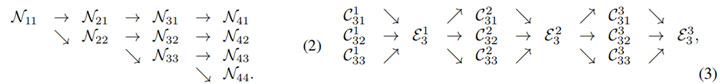

现有的姿态估计网络是通过将高分辨率的子网络串联到低分辨率的子网络而建立的,每个子网络组成一个阶段,由一系列卷积组成,并且相邻子网络之间存在一个向下采样层将分辨率减半.

Nsr 表示第s阶段的子网络,r是分辨率索引

N11 → N22 → N33 → N44

Parallel multi-resolution subnetworks 并行多分辨率子网络

我们从高分辨率子网开始作为第一步,逐步将高到低分辨率子网逐个添加,形成新的阶段,然后将多分辨率子网并行连接。结果,下一级并行子网的分辨率包括前一级的分辨率和一个较低的分辨率。如下图(2)

Repeated multi-scale fusion 反复多尺度融合

我们介绍了并行子网的交换单元(exchange units),以便每个子网络重复地从其他并行子网接收信息。这是交换方案结构的示例。我们将第三阶段分为几个(例如3个)交换块,每个块由3个并行卷积单元组成,跨并行单元的交换单元如下图(3)所示。r表示分辨率序号,b表示第b个块,s表示第s阶段,ξ是交换单元。

我们在图3中说明了交换单元,并在下面介绍了该公式。为了方便讨论,我们将下标s和上标b删除。ξ的输入是S个响应映射{X1…Xs},输出是s个响应映射{Y1…Ys},若跨尺度则输出是s+1个映射。它们的分辨率是相同的。每个Y是响应映射X的聚集,Yk = ∑a(Xi,k)。

函数a(Xi,k)由从i到k的分辨率上采样或下采样Xi组成。下采样使用3×3卷积核实现,例如使用一个步长为2的3×3卷积核进行2x下采样,使用两个连续的步长为2的3×3卷积核进行4x下采样。对于上采样,我们使用简单近邻采样,后接一个1×1卷积核对齐通道数。若分辨率相同,则为恒等连接。

Heatmap estimation

我们仅根据最后一个交换单元输出的高分辨率表示来回归热图,实验效果标明效果很好。定义为均方误差的损失函数用于比较预测的热图和真值热图。热图采用2D高斯在每个关键点的真值位置上以1个像素为中心的标准偏差来生成。

Network instantiation

我们通过遵循ResNet的设计规则实例化网络以进行关键点热图估计,以将深度分布到每个阶段,并将通道数分布到每个分辨率。

HRNet主体包含四个带有四个并行子网的阶段,其分辨率逐渐降低到一半,因此宽度(通道数)增加到两倍。 第一级包含4个残差单元,其中每个单元与ResNet-50相同,由宽度为64的瓶颈形成,然后是一个3×3卷积,将特征图的宽度减小为C。 第三,第四阶段分别包含1、4、3个交换块。 一个交换块包含4个残差单位,其中每个单位在每个分辨率中包含两个3×3卷积,并且在分辨率之间包含一个交换单位。 总之,总共有8个交换单元,即进行了8次多尺度融合。

在我们的实验中,我们研究了一个小网和一个大网:HRNet-W32和HRNet-W48,其中32和48分别代表了最后三个阶段中的高分辨率子网的通道数。其他三个并行子网的宽度为HRNet-W32的64、128、256和HRNet-W48的96、192、384。