网络结构分析

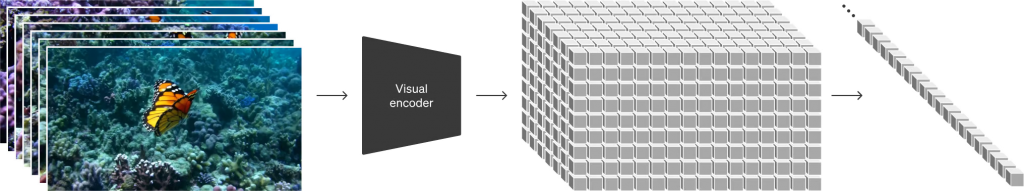

visual patches

支持各种尺寸、各种分辨率、各种长度的视频作为输入:https://arxiv.org/abs/2307.06304

视频降维

最大输入1920×1080

这个网络将原始视频作为输入,并输出一个时空压缩的潜在表示:https://arxiv.org/abs/1312.6114

我们还训练了一个相应的解码器模型(?),将生成的潜在空间映射回像素空间。

Sora本体

diffusion transformer:https://arxiv.org/abs/2212.09748 (transformer网络结构)

- 另外参考DALLE3(未开源)

- 参考DALLE2,text-to-image中的text是使用clip进行文到图对齐的,如何结合LLM?

使用时空潜在表示作为token输入,以及条件控制信息(text prompts),预测原始的无噪声patches

基于扩散模型生成先验,通过SDE迭代去噪来合成逼真的图像(或者用来生成训练数据):https://arxiv.org/abs/2108.01073

推理时通过在指定大小的网格中排列随机初始化(高斯噪声?)的patches,来控制生成的视频的大小。

- 单图 2048×2048

- 视频 60s 1920×1080

训练数据

大量具有相应文本字幕的视频

我们将DALL·E 3中介绍的re-captioning技术应用于视频,生成字幕?

- 首先训练一个高度描述性的字幕模型,然后使用它为我们训练集中的所有视频生成文本字幕(提高文本的准确性和视频的整体质量)

- 利用GPT将短用户提示转换为更长的详细说明

训练任务

首尾衔接的视频

从视频帧向后扩展

指定尾部预测首部

指定首尾,预测中间

mask中间帧

mask图像随机位置?

Minecraft游戏:Sora可以使用基本策略控制Minecraft中的玩家,同时以高保真度渲染世界及其动态。(训练集中加入指定提示词Minecraft+首帧+按键指令,预测下一帧+按键指令?进而自动探索?)

涌现能力

3D一致性:Sora可以生成具有动态摄像机运动的视频。随着摄像机的移动和旋转,人物和场景元素在三维空间中保持一致移动。

长程一致性和物体永久性:视频生成系统面临的一个重要挑战是在采样长视频时保持时间上的一致性。我们发现,Sora通常能够有效地模拟短程和长程依赖关系,尽管并非总是如此。例如,我们的模型可以在被遮挡或离开画面时仍然保留人、动物和物体的存在。同样,它可以在单个样本中生成同一角色的多个镜头,并在整个视频中保持它们的外观。

与世界互动:Sora有时可以模拟影响世界状态的简单行为。例如,画家可以在画布上留下新的笔触,这些笔触会随着时间的推移而持续存在,或者一个人可以吃汉堡并留下咬痕。

弱项or幻觉

物理引擎:物理上不可能的动作,不准确的物理建模,不自然的物体“变形”。

出现和消失:动物或人可能会自发地出现,特别是在包含许多实体的场景中。

交互:模拟物体和多个角色之间的复杂交互对模型来说是具有挑战性的。

![[翻译]Online Hybrid CTC/Attention Architecture for End-to-end Speech Recognition](https://blog.mclover.cn/wp-content/themes/slanted/img/thumb-medium.png)